LoRA 학습법 (Google Colab)

Google Colab에서 Stable Diffusion LoRA를 학습하는 방법

Google Colab으로 Stable Diffusion LoRA를 학습하는 방법을 소개해요.

LoRA(Low-Rank Adaptation)는 대규모 모델을 효율적으로 파인튜닝하는 기법입니다. 적은 학습 데이터와 컴퓨팅 자원으로도 원하는 스타일의 이미지를 생성할 수 있어요.

준비물

- Google Drive 계정

- 중복 없는 고품질 이미지 최소 20장

- 인내심 (학습에 시간이 좀 걸립니다)

테스트용 이미지: 아이오닉6 샘플 이미지

Data Maker

Data Maker에 접속하세요.

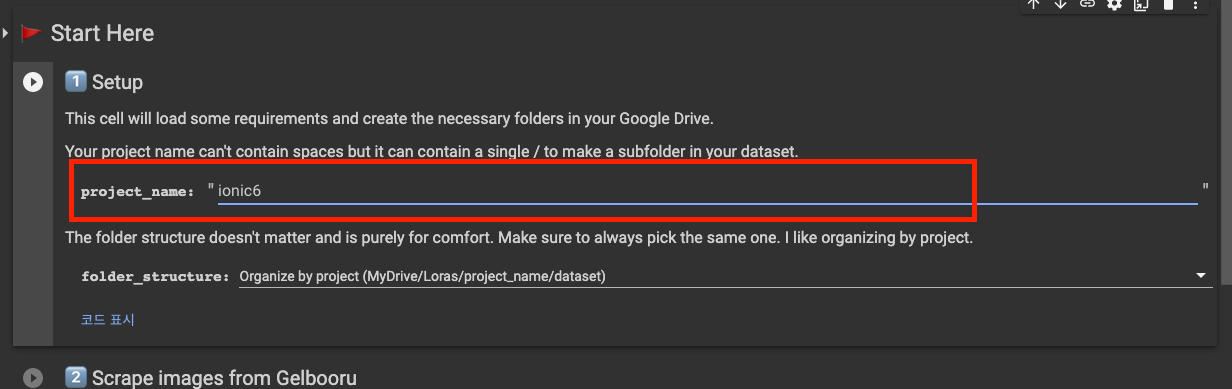

1단계: Setup

프로젝트명을 입력하고 Setup 셀을 실행합니다.

완료되면 Google Drive에 Loras/{project_name}/dataset 폴더가 생겨요. 여기에 준비한 이미지를 업로드하세요.

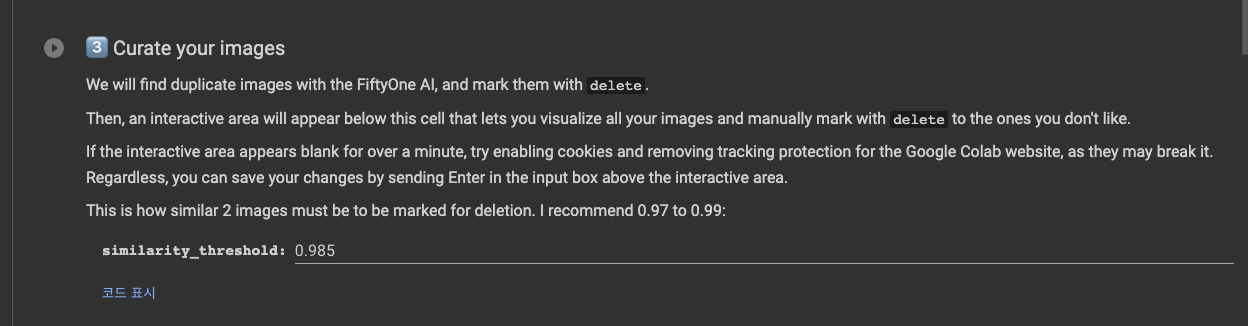

2단계: Curate Your Images

중복 이미지와 저품질 이미지를 제거합니다. “Scrape images from Gelbooru” 단계는 건너뛰어도 돼요.

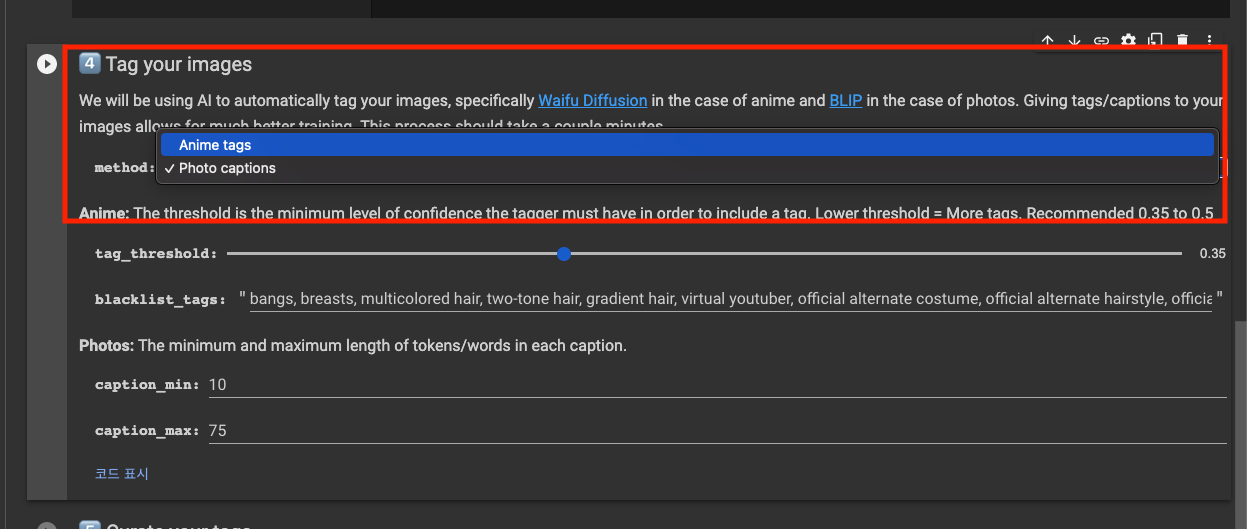

3단계: Tag Your Images

이미지에 태그를 자동 생성합니다. 실사 사진은 “Photo captions”, 애니메이션이나 일러스트는 “Anime tags”를 선택하세요.

4단계: Ready

Ready 셀을 실행한 뒤 게 아이콘 버튼을 클릭해서 LoRA Trainer로 이동하세요.

LoRA Trainer

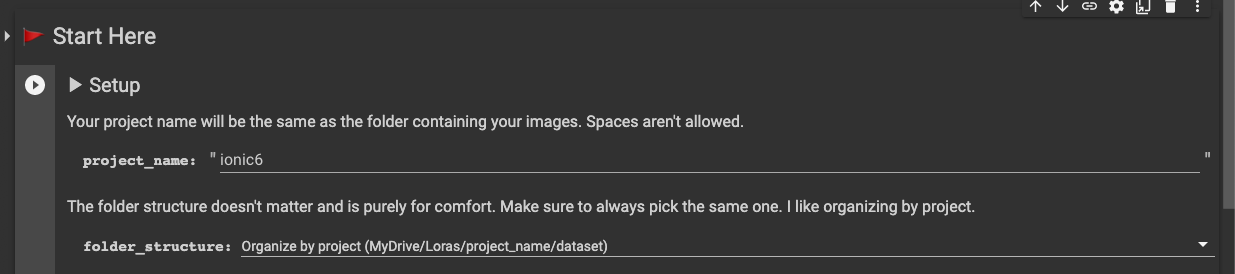

Setup 설정

프로젝트명은 Data Maker에서 쓴 것과 동일하게 입력합니다.

Step 설정

num_repeats 값은 이미지 수에 따라 정해요.

| 이미지 수 | Repeats | Epochs | Batch Size | 총 Steps |

|---|---|---|---|---|

| 20장 | 10 | 10 | 2 | 1000 |

| 100장 | 3 | 10 | 2 | 1500 |

| 400장 | 1 | 10 | 2 | 2000 |

계산 공식: 이미지 수 × num_repeats × epochs ÷ batch size = total steps

권장: 이미지 수 × num_repeats가 200~400 범위

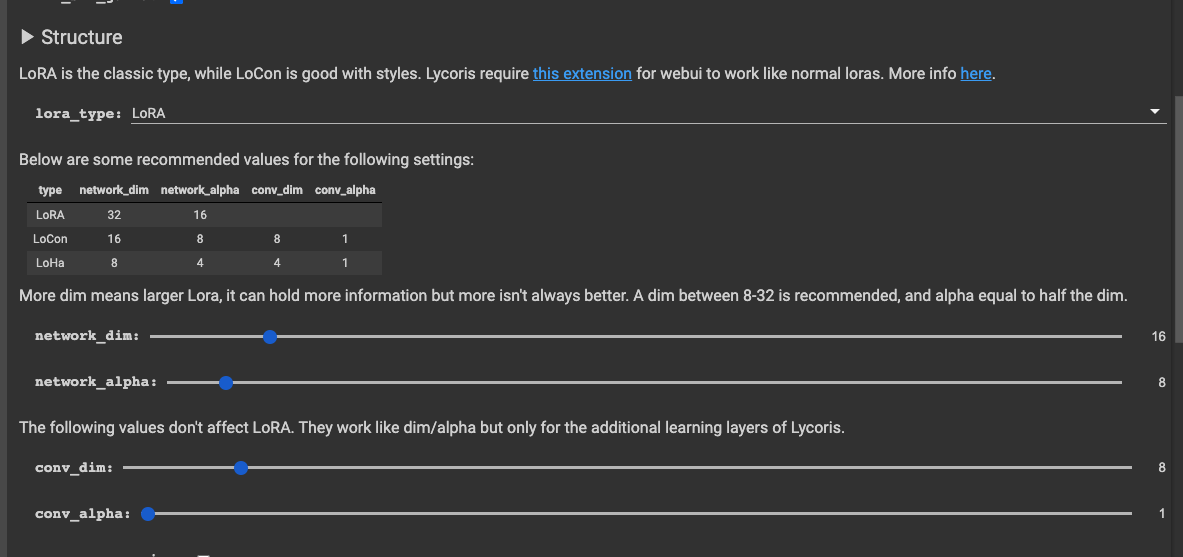

Structure 설정

| 파라미터 | 권장값 | 설명 |

|---|---|---|

network_dim | 8-128 | LoRA rank (클수록 표현력↑, 용량↑) |

network_alpha | dim/2 | 학습률 조정 파라미터 |

설정을 마치면 실행하세요. 20장 기준 약 30분 걸립니다.

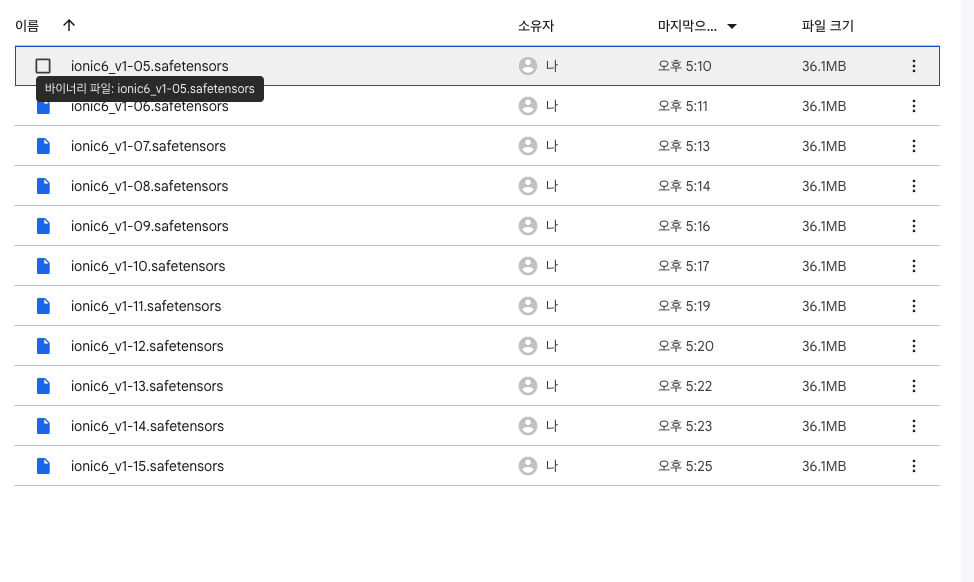

결과 확인

학습이 끝나면 Google Drive 프로젝트 폴더 안에 output 폴더가 생깁니다.

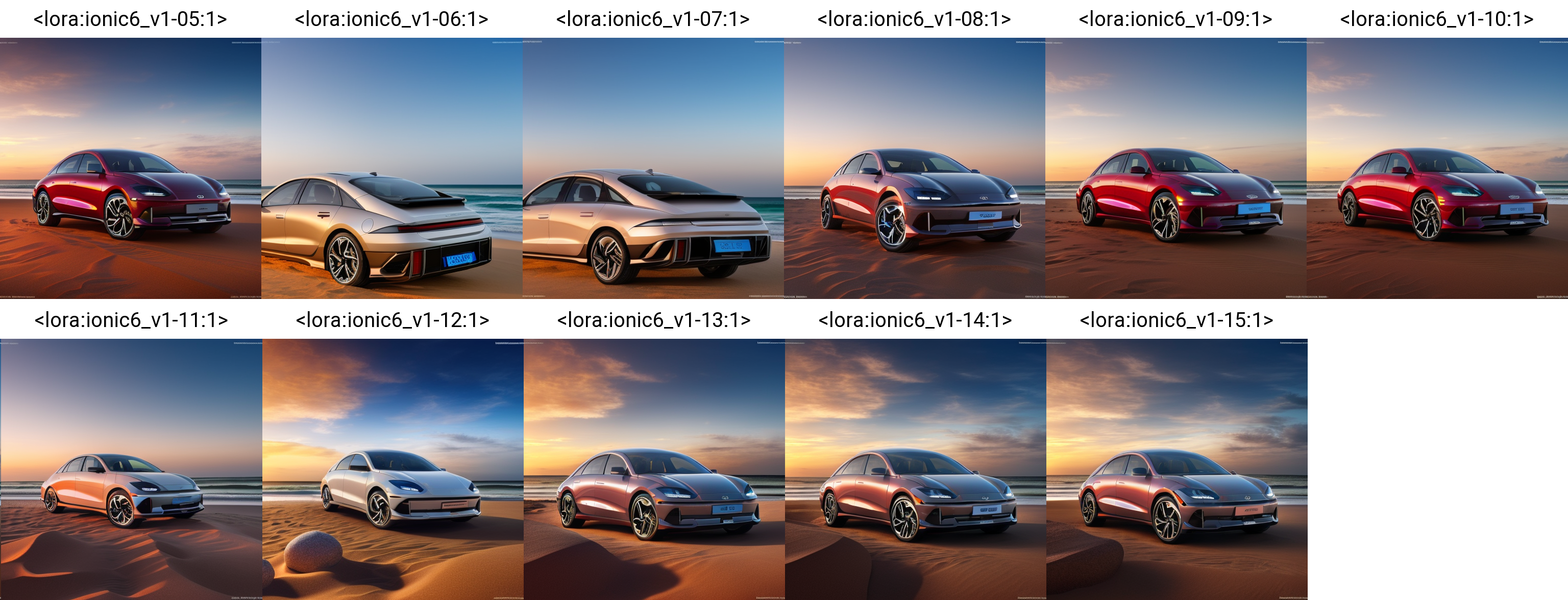

팁

- 해상도 512x512 이상의 고품질 이미지를 일관되게 쓰세요

- num_repeats를 적절히 설정하세요

- 여러 epoch 결과물을 테스트해 보세요

- 원하는 결과가 나올 때까지 반복하세요